Kebijaksanaan konvensional mengatakan: "Jika Anda tidak ingin data Anda digunakan, mundurlah dari semuanya."

Kami mengatakan: "Jika data Anda tetap dikumpulkan, lebih masuk akal untuk memengaruhi cara penggunaannya."

Bukan: "Apakah perusahaan harus memiliki data saya?" (Mereka sudah memilikinya).

Pertanyaan sebenarnya adalah: "Apakah data saya seharusnya berkontribusi dalam membangun AI yang lebih baik untuk semua orang?"

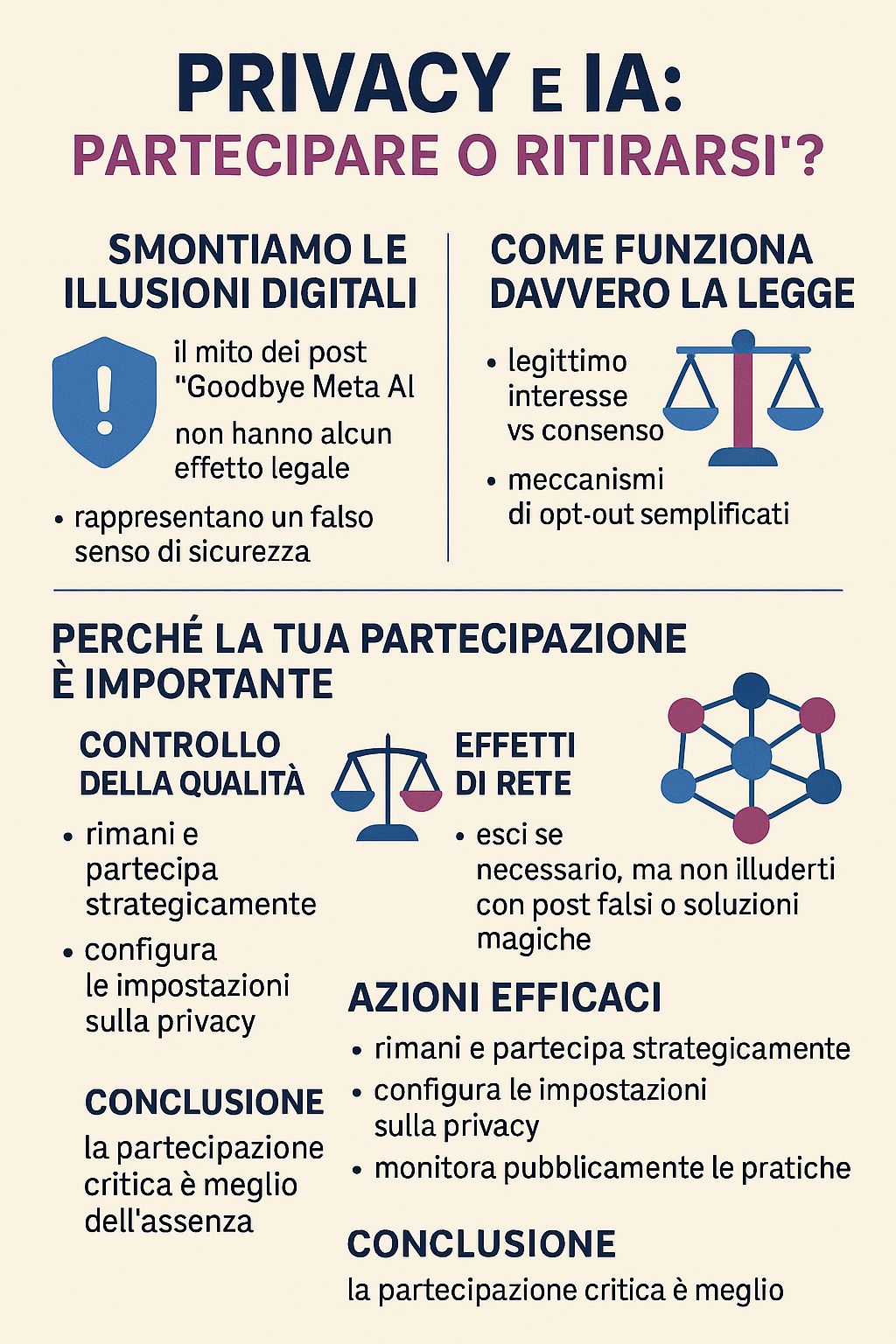

Sebelum membangun argumen yang serius, sangat penting untuk membongkar ilusi berbahaya yang beredar di media sosial: postingan viral "Goodbye Meta AI" yang menjanjikan untuk melindungi data Anda hanya dengan membagikan pesan.

Kebenaran yang tidak menyenangkan: postingan-postingan ini sepenuhnya palsu dan dapat membuat Anda lebih rentan.

Seperti yang dijelaskan oleh Meta sendiri, "membagikan pesan 'Goodbye Meta AI' bukanlah bentuk penolakan yang sah". Postingan-postingan ini:

Kesuksesan viral dari postingan-postingan ini mengungkap masalah yang lebih mendalam: kita lebih memilih solusi sederhana dan ilusif daripada keputusan yang kompleks dan terinformasi. Membagikan sebuah postingan membuat kita merasa aktif tanpa perlu repot-repot memahami bagaimana hak-hak digital kita sebenarnya berfungsi.

Namun, privasi tidak dapat dilindungi dengan meme. Privasi dilindungi dengan pengetahuan dan tindakan yang sadar.

Sejak 31 Mei 2025, Meta telah menerapkan sistem baru untuk pelatihan AI dengan menggunakan "kepentingan sah" sebagai dasar hukum, bukan persetujuan. Ini bukanlah celah hukum, melainkan alat hukum yang diatur dalam GDPR.

Kepentingan yang sah memungkinkan perusahaan untuk memproses data tanpa persetujuan eksplisit jika mereka dapat membuktikan bahwa kepentingan mereka tidak melebihi hak pengguna. Hal ini menciptakan zona abu-abu di mana perusahaan "menyesuaikan undang-undang" melalui penilaian internal.

Penggunaan data yang tidak dianonimkan menimbulkan "risiko tinggi terjadinya pembalikan model, kebocoran memori, dan kerentanan ekstraksi". Daya komputasi yang diperlukan berarti hanya aktor dengan kapasitas sangat tinggi yang dapat memanfaatkan data ini secara efektif, menciptakan ketidakseimbangan sistemik antara warga negara dan korporasi besar.

Sekarang setelah kita telah menjelaskan aspek hukum dan teknisnya, mari kita bangun argumen untuk partisipasi strategis.

Ketika orang-orang yang sadar memilih untuk mundur, AI akan dilatih menggunakan data dari mereka yang tersisa. Apakah Anda ingin sistem AI didasarkan terutama pada data dari orang-orang yang:

Prasangka dalam AI terjadi ketika data pelatihan tidak representatif. Partisipasi Anda membantu memastikan:

Sistem kecerdasan buatan (AI) semakin baik seiring dengan skala dan keragaman:

Jika Anda menggunakan fitur berbasis AI (pencarian, terjemahan, rekomendasi, alat bantu aksesibilitas), partisipasi Anda membantu meningkatkan fitur tersebut untuk semua orang, termasuk pengguna di masa depan yang paling membutuhkannya.

Privasi Anda tidak mengalami perubahan signifikan antara opsi opt-in dan opt-out untuk AI. Data yang sama sudah digunakan untuk:

Perbedaannya adalah apakah data ini juga berkontribusi untuk meningkatkan kecerdasan buatan (AI) bagi semua orang atau hanya melayani kepentingan komersial segera dari platform tersebut.

Inilah tepatnya alasan mengapa orang-orang yang bertanggung jawab seperti Anda harus ikut serta. Menarik diri tidak akan menghentikan perkembangan kecerdasan buatan (AI), tetapi hanya akan menghilangkan suara Anda dari proses tersebut.

Sistem kecerdasan buatan (AI) akan tetap dikembangkan. Pertanyaannya adalah: apakah dengan atau tanpa kontribusi dari orang-orang yang secara kritis memikirkan isu-isu ini?

Memang bisa dimengerti. Tapi pertimbangkan ini: apakah Anda lebih suka sistem AI dibangun dengan atau tanpa kontribusi dari orang-orang yang sama skeptisnya dengan Anda terhadap perusahaan-perusahaan besar?

Ketidakpercayaan Anda justru menjadi alasan mengapa partisipasi kritis Anda sangat berharga.

Kecerdasan buatan sedang menjadi kenyataan, apakah Anda ikut serta atau tidak.

Pilihan Anda bukanlah apakah AI akan dibangun, tetapi apakah AI yang akan dibangun akan mencerminkan nilai-nilai dan perspektif orang-orang yang memikirkan isu-isu ini dengan cermat.

Memilih untuk tidak ikut serta (opt-out) sama saja dengan tidak memilih. Hal itu tidak menghentikan pemilihan, melainkan hanya berarti hasilnya tidak akan memperhitungkan kontribusi Anda.

Dalam dunia di mana hanya aktor dengan kemampuan komputasi yang sangat tinggi yang dapat menginterpretasikan dan memanfaatkan data ini secara efektif, suara kritis Anda dalam pelatihan dapat memiliki dampak yang lebih besar daripada ketidakhadiran Anda.

Tetaplah dan berpartisipasilah secara strategis jika:

Dan sementara itu:

Tapi jangan tertipu dengan:

Penolakan Anda secara individu memiliki dampak minimal terhadap privasi Anda, tetapi tetap tinggal memiliki dampak nyata bagi semua orang.

Dalam dunia di mana sistem kecerdasan buatan (AI) akan menentukan aliran informasi, keputusan, dan interaksi antara manusia dan teknologi, pertanyaannya bukanlah apakah sistem-sistem ini harus ada, tetapi apakah mereka harus memasukkan sudut pandang orang-orang yang reflektif dan kritis seperti Anda.

Terkadang, tindakan paling radikal bukanlah menyerah. Seringkali, cara paling radikal adalah tetap tinggal dan memastikan suara kita didengar.

Anonim

Ini bukan soal mempercayai perusahaan secara buta atau mengabaikan kekhawatiran terkait privasi. Ini soal menyadari bahwa privasi tidak dilindungi dengan meme, tetapi dengan partisipasi strategis dan sadar.

Dalam ekosistem di mana ketidakseimbangan kekuasaan sangat besar, suara kritis Anda dalam pelatihan AI dapat memiliki dampak yang lebih besar daripada ketidakhadiran Anda yang protes.

Apapun pilihanmu, pilihlah dengan kesadaran, bukan dengan ilusi digital.

Sebuah paragraf simpati juga untuk para "pertapa privasi" - jiwa-jiwa murni yang percaya bahwa mereka dapat sepenuhnya menghindari pelacakan digital dengan hidup offline seperti para biksu Tibet pada tahun 2025.

Spoiler: Meskipun Anda pindah ke sebuah pondok terpencil di Pegunungan Dolomiti, data Anda sudah tersebar di mana-mana. Dokter umum Anda menggunakan sistem digital. Bank tempat Anda menyimpan tabungan untuk membeli kayu bakar melacak setiap transaksi. Supermarket di desa memiliki kamera pengawas dan sistem pembayaran elektronik. Bahkan tukang pos yang mengantarkan tagihan Anda berkontribusi pada dataset logistik yang menggerakkan algoritma optimasi.

Pengecualian digital total pada tahun 2025 pada dasarnya berarti mengisolasi diri dari masyarakat. Anda dapat berhenti menggunakan Instagram, tetapi Anda tidak dapat berhenti menggunakan sistem kesehatan, perbankan, pendidikan, atau pekerjaan tanpa konsekuensi dramatis terhadap kualitas hidup.

Dan sementara Anda membangun gubuk anti-5G Anda, data Anda tetap ada dalam database rumah sakit, bank, asuransi, pemerintah daerah, kantor pajak, dan tetap digunakan untuk melatih sistem yang akan memengaruhi generasi mendatang.

Paradoks pertapa: isolasi protes Anda tidak mencegah sistem kecerdasan buatan (AI) dilatih menggunakan data dari orang-orang yang kurang sadar, tetapi menghalangi Anda untuk mempengaruhi perkembangannya ke arah yang lebih etis.

Pada dasarnya, Anda telah meraih kemurnian moral yang tak tercemar dari mereka yang mengamati sejarah dari tribun penonton, sementara yang lain—yang kurang tercerahkan namun lebih aktif—menulis aturan mainnya.

Apapun pilihanmu, pilihlah dengan kesadaran, bukan dengan ilusi digital.

Artikel yang dikutip:

Penjelasan lebih lanjut tentang GDPR dan kepentingan sah:

Sumber daya resmi:

Untuk tindakan konkret: jika Anda berada di Eropa, periksa prosedur resmi opt-out di Garante Privacy. Untuk informasi umum, lihat pengaturan privasi dan syarat layanan platform Anda. Dan ingat: tidak ada postingan di media sosial yang memiliki nilai hukum.